„Az AI Now Institute éves jelentése és ajánlásai a mesterséges intelligencia alkalmazására, szabályozására.

A mesterséges intelligencia (MI) társadalmi hatásaival foglalkozó kutatóintézet, a New York Egyetem kebelén belül működő AI Now Institute közzétette harmadik éves jelentését, amelyben tíz pontban összefoglalt ajánlást is megfogalmaztak a kormányzat, a kutatók és az iparági szereplők felé.

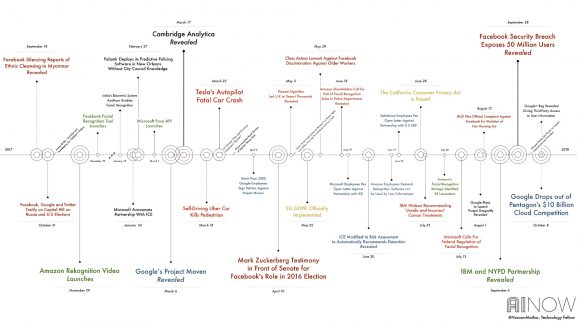

2018 nem szűkölködött drámai eseményekben az MI terén. Mint a szerzők emlékeztetnek rá, a Facebook etnikai tisztogatás felbujtóinak eszköze lett Myanmarban, a Cambridge Analytica az amerikai választásokat manipulálta, a Google titkos cenzor-eszközöket épített be a Kínában eladott keresőmotorjaiba, az Amazon dolgozói pedig többször is fellázadtak az algoritmus-vezérelt raktárakban – egyik címlapsztori a követte a másikat, és ez még mindig csak a jéghegy csúcsa.

Az egymást követő MI-botrányok alapproblémája ugyanaz: a felelősség kérdése. Ki a felelős azért, ha a mesterséges intelligencia kárt okoz nekünk? Hogyan tudjuk felismerni és megérteni ezeket a károkat, és hogyan tudjuk orvosolni azokat? Hol van az a pont, amikor be kell avatkoznunk, és milyen további kutatások szükségesek ahhoz, hogy a beavatkozások hatásosságáról képünk legyen? Jelenleg kevés válaszunk van a kérdésekre, a meglévő szabályozási keret pedig a szükségesnél jóval kevesebbre terjed ki. Az MI-rendszerek elterjedtsége, összetettsége és mérete ugyanakkor folyamatosan nő, így az elszámoltathatóság és a megfelelő felügyelet hiánya növekvő aggodalmakra ad okot. Az intézet mindezek figyelembe vételével a következő ajánlásokat fogalmazta meg.

- A kormányzatnak az MI-szabályozásban szektor-specifikus ügynökségek erősítésével kellene megoldania az adott területek technológiai felügyeletét, auditálását és monitorozását. Az olyan szakterületeknek, mint az egészségügy, oktatás, bűnüldözés, igazságszolgáltatás vagy a jóléti szolgáltatások, megvannak a maguk története, szabályozási keretrendszere és kockázatai. Egy MI-t felügyelő országos szervezet vagy az általános MI-követelmények alkalmazása nehézségekbe ütközhet, ha szektorális szakmai követelményekkel kerül szembe. Ezért van minden szakterületen szükség a szektor-specifikus megközelítésre.

- Az arc- és érzelemfelismerő technológiákat szigorúan szabályozni kell a közérdek és a magánszféra védelmének érdekében. Olyan szabályozásra van szükség, nemzeti szinten is, amelyek erős felügyeletet, világos korlátozásokat és nyilvános átláthatóságot biztosítanak. A közösségeknek biztosítani kell a jogot arra, hogy elutasítsák ezeket a technológiákat, akár a magánélet, akár a közérdek védelmében. Az egyszerű nyilvános figyelmeztetés nem elegendő, a hozzájáruláshoz magas küszöböt kell megállapítani, tekintve a folyamatos megfigyelés elnyomó jellegére. Különös figyelmet kell fordítani az érzelemfelismerő alkalmazásokra, ami az arcfelismerés egyik leágazását jelenti, de kellő tudományos megalapozottság nélkül, gyakran áltudományos megközelítésekből kiindulva, etikátlan és felelőtlen módon alkalmazva. Összekapcsolása a munkaerő-felvétellel, biztosításhoz való hozzáféréssel, oktatással vagy rendfenntartással súlyos aggodalmakra adhat okot, egyéni és társadalmi szinten egyaránt.

- Az MI-iparágnak új megközelítésre van szüksége a vállalati irányításban. Mint a jelentésből is kiderül, a legtöbb info-technológiai vállalat belső irányítási rendszere nem biztosítja MI-rendszereik átláthatóságát. A kormányzati szabályozáson túl fontos, hogy a vállalatok is rendelkezzenek olyan elszámoltathatósági rendszerrel, amely túlmegy az etikai irányelveken. Ilyen lehet a megfelelő dolgozói képviselet az igazgatótanácsban, külső etikai tanácsadó testület létrehozása, vagy független nyomonkövetési és átláthatósági törekvések érvényesülése. A külső szakemberek számára biztosítani kell a teljes MI-infrastruktúra megérthetőségét, képessé téve őket a kulcs-rendszerek auditjára és ezek eredményének publikálására.

- Az MI-vállalatoknak engedniük kellene az üzleti titkok és más jogi igények terén a közszféra elszámoltathatósága érdekében. A vállalati szférában az üzleti titokra vonatkozóan elfogadott gyakorlat homályossá és elszámoltathatatlanná teszi az MI-rendszereket, mintegy „fekete dobozként” telepítve azokat, ami megnehezíti az elfogultság figyelembe vételét, a döntések megvitathatóságát és a hibák orvoslását. Azok a szállítók és fejlesztők, amelyek kormányzati megrendelésre hoznak létre döntés-automatizáló és MI-rendszereket, el kellene fogadniuk, hogy lemondanak minden olyan üzleti titokvédelemről és más jogi feltételről, amelyek megakadályozzák alkalmazásaik értelmezhetőségét és auditálhatóságát. A közszféra megrendelőinek ezt a szerződés feltételeként kellene megfogalmazniuk a szállítók felé.

- Az infokommunikációs technológiai cégeknek védelmet kellene biztosítania a lelkiismereti alapon tiltakozóknak, a munkavállalói szerveződéseknek és az etikai okokból kiszivárogtatóknak. A technológiai cégek dolgozóinak önszerveződése és ellenállása olyan erővé nőtte ki magát, amely képes segíteni az elszámoltathatóságot és az etikus döntéshozatalt. A cégeknek biztosítaniuk kell a dolgozók lehetőségét az önszerveződésre, kiszivárogtatásra, valamint etikai döntésre a tekintetben, hogy mely projektekben hajlandóak dolgozni, világos és nyílt vállalati politika megfogalmazásával és megvalósításával.

- A fogyasztóvédelmi ügynökségeknek az MI-termékeknél és -szolgáltatásoknál is alkalmazniuk kellene a megtévesztő reklámozás elleni jogszabályokat. A mesterséges intelligencia iránti lelkesedés folyamatosan nő, és ezzel együtt az a rés is, amely adott esetben a marketing-ígéretek és a tényleges teljesítmény között feszül. Ez növekvő kockázatot jelent mind a magánszemélyeknek, mind a vállalkozásoknak. Az MI-szállítókkal szemben magas követelményeket kell támasztani annak érdekében, hogy ígéreteik valóságosak legyenek, különösen olyan esetekben, amikor a tudományos bizonyíthatóság még kétséges, vagy keveset tudunk a hosszútávú hatásokról.

- Az info-technológiai vállalatoknak el kellene köteleznie magukat a munkahelyi kirekesztés és diszkrimináció elleni fellépésre. A technológiai cégekre jellemző a „csővezeték-szemléleten” alapuló vállalati modell, amikor sokféle munkavállalót vesznek fel és képeznek ki, de nem fordítanak figyelmet arra, hogy később esetleg milyen nemi, faji, etnikai, szexuális vagy fogyatékossággal kapcsolatos kirekesztésnek, hátrányos megkülönböztetésnek lehetnek kitéve. Ezek ellen nem csak az esetek mélyreható feltárásával és megfelelő eszközök biztosításával kellene fellépniük, hanem gyakorlati akciókkal is.

- A tisztességesség, elszámoltathatóság és átláthatóság érvényesítése az MI terén részletes beszámolókat igényel a teljes értékláncban. Az érdemi elszámoltathatósághoz szükséges az MI-rendszerek minden elemének megértése és nyomon követése a teljes értékláncban, a termék életciklusának minden szakaszában. Ebbe beletartozik a tényleges környezeti terhelés és munkaerő valós költségeinek megismerése is, a felelős auditálás szükséges feltételeként.

- Több forrás és támogatás a jogvitákra, a munkavállalói szerveződéseknek és a közösségi részvételnek. Azok, akik leginkább kárt szenvedhetnek az MI-rendszerektől, gyakran éppen azok a csoportok, amelyek a legkevésbé képesek magukat megvédeni, elvitatni az eljárások eredményét. Szükséges ezért erőteljes támogatást adni minden olyan mechanizmusnak, amely jogorvoslatot és civil részvételt biztosíthat, beleértve a hátrányos helyzetűek nyilvános szószólóit, civil szerveződéseket és dolgozói érdekvédelmi szervezeteket.

- Az egyetemi MI-programoknak többet kell nyújtania, mint amit az informatikai ismeretek és a mérnöki tudományok jelentenek. Az MI eredendően interdiszciplináris területként jelent meg, az idők során azonban egyre inkább leszűkült műszaki tudománnyá. Mivel azonban egyre szélesebb körben alkalmazzuk humán területeken is, szükséges kiterjeszteni tudományos kitekintését, beemelve a társadalmi és humán tudományok szakértőit is a képzésbe. A tudományos orientáció kiterjesztése biztosíthatja a mélyebb figyelmet a társadalmi összefüggésekre, és tudatosíthatja a potenciális veszélyeket a mesterséges intelligencia társadalmat és egyéneket érintő alkalmazásakor.

”

Forrás:

After a Year of Tech Scandals, Our 10 Recommendations for AI. Let’s begin with better regulation, protecting workers, and applying “truth in advertising” rules to AI; AI Now Institute; Medium; 2018. december 6.

AI in 2018: A Year in Review; AI Now Institute; Medium; 2018. október 24.

AI Now Report 2018; AI Now Institute; 2018. december (PDF)

Lásd még:

AI Now Institute; New York University

AI Now 2017 Report (PDF)

The AI Now Report (2016) (PDF)